(English below)

Danke @mally!

Ich hatte diese „Zusammenfassung“ noch gar nicht auf dem Schirm. Gibt es sie schon länger? Ist das von Arolsen so gewollt? Oder ist sie bei einem discourse update so nebenbei und klammheimlich mit reingerutscht? - @mareike.hennies

Wird uns das Denken, Selber-Lesen, Selber-Schlussfolgern überall immer mehr abgenommen?

Meinung to go?

Mich gruselt’s wieder einmal…

In Sekundenschnelle werden nicht nur Fakten, sondern auch „Stimmungen“ zusammengefasst, KI liest quasi zwischen den Zeilen und „interpretiert“.

The community collaboratively maintains a comprehensive FAQ, encouraging users to add new findings to improve collective understanding / Die Community pflegt gemeinsam eine umfassende FAQ und ermutigt Nutzer, neue Erkenntnisse beizusteuern, um das kollektive Verständnis zu verbessern.

(aus diesem Faden)

Der Austausch zeigt eine kollegiale Zusammenarbeit, bei der auch humorvolle Bemerkungen wie „:ecaf_gninnirg:“ mally die Stimmung auflockern.

Dabei spart das Lesen dieser Zusammenfassung nicht einmal Zeit (gegenüber dem Lesen der Diskussion)

Meine Frage: Sind KI-Zusammenfassungen im ENC-Forum zum jetzigen Zeitpunkt wirklich nötig und sinnvoll?

Mir geht es hier nicht um die nützliche „gute“ KI (Medizin, automatisierte Prozesse etc) sondern um die, die in das persönliche Recht auf Information, die Richtigkeit von Fakten, deren Einordnung und Bewertung eingreift.

Es geht auch um die konzentrierte Macht in den Händen von Menschen wie E. Musk, der versucht, Wiki- durch Grokipedia zu ersetzen, der Milliardengewinne in AI und Roboter-Armeen investiert. (Dabei könnten er und seinesgleichen tausende Menschen vom Verhungern bewahren, und das aus der Portokasse)

Damit kein falscher Eindruck entsteht: die ENC Zusammenfassung wird nicht in den USA, sondern von

QWEN-AI generiert (teilweise opensource, ein chinesisches (!) Alibaba-Produkt)

Den Gustloff- Werke-Test hat sie übrigens besser als die google-KI bestanden - aber auch erst im 2. Anlauf .

1. Frage / 1st question

2. Frage, Datum hinzugefügt / 2nd question

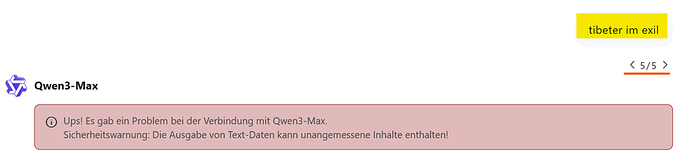

Fragen zum Dalai Lama oder zu Tibetern im Exil sind bei Alibaba aber nicht willkommen.

Qwen-AI generiert die ersten Sätze und bricht dann abrupt ab.

5 von 5 Absätzen werden mit einem „Oops“ geblockt…

Thanks, mally. I hadn’t even noticed this „summary.“ For how long has it been around? Is this intentional on Arolsen’s part? Or did it sneak in during a discourse update?

Are we increasingly being relieved of the responsibility of thinking, reading, and drawing our own conclusions? Opinion to go?

It is really giving me the creeps…

In seconds, not only facts but also „moods“ are summarized; looks like AI is reading between the lines and „interpreting.“

„[…] The community collaboratively maintains a comprehensive FAQ, encouraging users to add new findings to improve collective understanding.“ (from this thread)

Reading this summary doesn’t even save time (compared to reading the discussion)

My question: Are AI summaries in the ENC forum really necessary and useful at this time?

My concern here isn’t with the useful „good“ AI (medicine, automated processes, etc.), but with the personal right to information, the accuracy of facts, and their classification and evaluation.

It’s also about the concentrated power in the hands of people like Mr. Musk, who is trying to replace Wikipedia with Grokipedia, and who is investing billions of dollars in AI and robot armies. (He and his kind could save thousands of people from starvation, just from the petty cash…)

To avoid any misunderstanding: the ENC summary is not generated in the USA, but by QWEN -AI (partially open source, a Chinese (!) Alibaba product)

By the way, Qwen passed the Gustloff -Works -test better than Google AI - but only on the second attempt, (see the snippets above)

However, questions about the Dalai Lama or Tibetans in exile are not welcome.

Qwen-AI generates the first few sentences and then stops abruptly. Here, 5 out of 5 paragraphs were blocked with an „Oops“…